|

许多站长都有查看网站日志的习惯,这么做的主要目的就是为了分析蜘蛛爬行网站的情况,当然其中多数站长也只是简单的了解一下当天蜘蛛爬行的次数,这一点就足够发现问题了。有时候,我们会觉得自己的网站已经相当完美了,而正常优化过程中,蜘蛛却对此不感冒,让人很是着急。

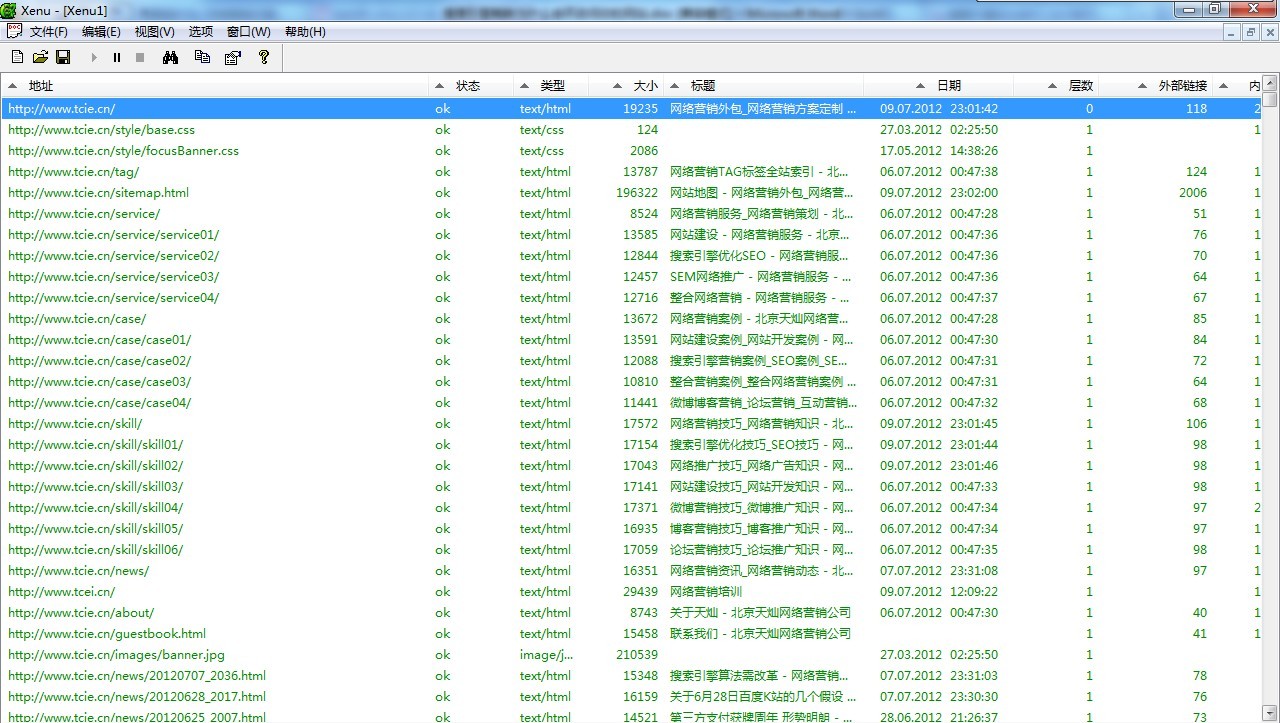

了解原理就很容易理解,搜索引擎借助蜘蛛在互联网这张大网中搜寻“猎物”,它唯一所能依据的线索就是链接了,找到新的链接后,根据复杂的算法最终对网站进行排名,储存在数据库中。很多网站可能会因为网站结构混乱失去蜘蛛到访的机会,然而蜘蛛不访问网站的因素有很多,下面我们一起总结一下: 图片、flash等内容过多 不得不说,搜索引擎发展到现在,已经比较的智能化了,去年google就推出了图片搜索功能,能够分析图片的色彩、像素比例而找到图片的出处。然而这项技术对于搜索引擎完全的识别图片中的信息还有不小的差距,而很多站长或是不懂得搜索引擎优化,或是考虑网站美观和内容丰富,往往会在页面中嵌入大量高清图片、flash,即使你的网站内容再好,蜘蛛也无法知道,只能绕道而行了。现在网络上有许多模拟蜘蛛抓取的工具,有类似情况的网站站长可以查询一下自己网站的信息,看看蜘蛛能够发现的信息和人眼看到的有多大差距。 网站死链接过多 我们可以想象,蜘蛛兴高采烈的来到你的网站,开始逐个链接的搜寻,以为发现了一堆好的内容,然而却是一堆打不开的链接等着她,一次、两次、三次,每次来都是这种情况,所以她生气了,就再也不会访问你的页面了。大部分的网站都存在死链接,只要我们能够及时的发现并清除掉就没有问题了,你可以利用强大的xenu,也可以查看你的网站日志,发现返回404状态码的一律清除。

上图是用xenu扫描时的界面。 外链与nofollow 之所以蜘蛛能够成功的找到并访问你的站点,是因为其他网站上存在你网站的链接。想要蜘蛛更频繁的光临,在建立外链时就应该考虑外链网站权重,收录数越大、PR值越高,快照更新越快的网站权重就越高。另外有些无良站长在做友情链接时,会有意设置nofollow,这样的外链在蜘蛛眼里形同虚设,如果你网站的外链有这种现象,请及时撤除。

网站代码复杂 网站建设中,代码优化非常重要,冗长代码对网站无任何意义,而且还会影响打开速度和搜索引擎蜘蛛的判断。 网站逻辑结构复杂 正确的网站逻辑结构应该是扁平状的树形结构,也就是说,蜘蛛通过首页访问,能够达到任何一个栏目页,通过栏目页又能达到任何一个内容页,这个次数应该被限定在3次以内(较大的网站可以多几层)。如果网站层次太多,网站权重又不够高,蜘蛛就没有兴趣去一层层的搜寻了。 网站地图错误 网站地图是搜索引擎全面认识网站的好工具,对于蜘蛛而言,网站地图就像花名册,好的网站地图能让蜘蛛很有指向性的访问网站中的任何页面。所以,我们在制作网站地图时就需要谨慎行事了。网络上也有很多制作网站地图的工具,为了确保万无一失,大家也可以作为访客进行访问来加以验证。本文由网络营销公司提供,转载请注明出处。 (责任编辑:admin) |